Россия превратила искусственный интеллект в инструмент создания лжи в интернете. Как противодействовать фейковым новостям и комментариям ботов.

“Вы внимательно наблюдаете? Каждый большой магический трюк состоит из трех актов. Первый акт – это наживка: иллюзионист показывает вам нечто обычное: колоду карт, птицу или человека. Он показывает вам этот объект и просит проверить, действительно ли это то, чем оно кажется. Второй акт называется превращением: иллюзионист берет это обычное что-то и заставляет совершить что-то необычное.

Теперь вы ищете секрет, но не найдете его, потому что вы невнимательно смотрите. Но не торопитесь хлопать в ладоши, потому что заставить что-то исчезнуть недостаточно. Нужно вынудить его вернуться. Вот почему каждый магический трюк имеет третий акт, самую сложную часть, которую мы называем престижем”.

Парадоксально, но этот монолог в начале фильма Кристофера Нолана “Престиж“ объясняет не только ключевые моменты сюжета и структуры трюков, которые отражены в ленте, но служит идеальным описанием того, как работает российская пропаганда.

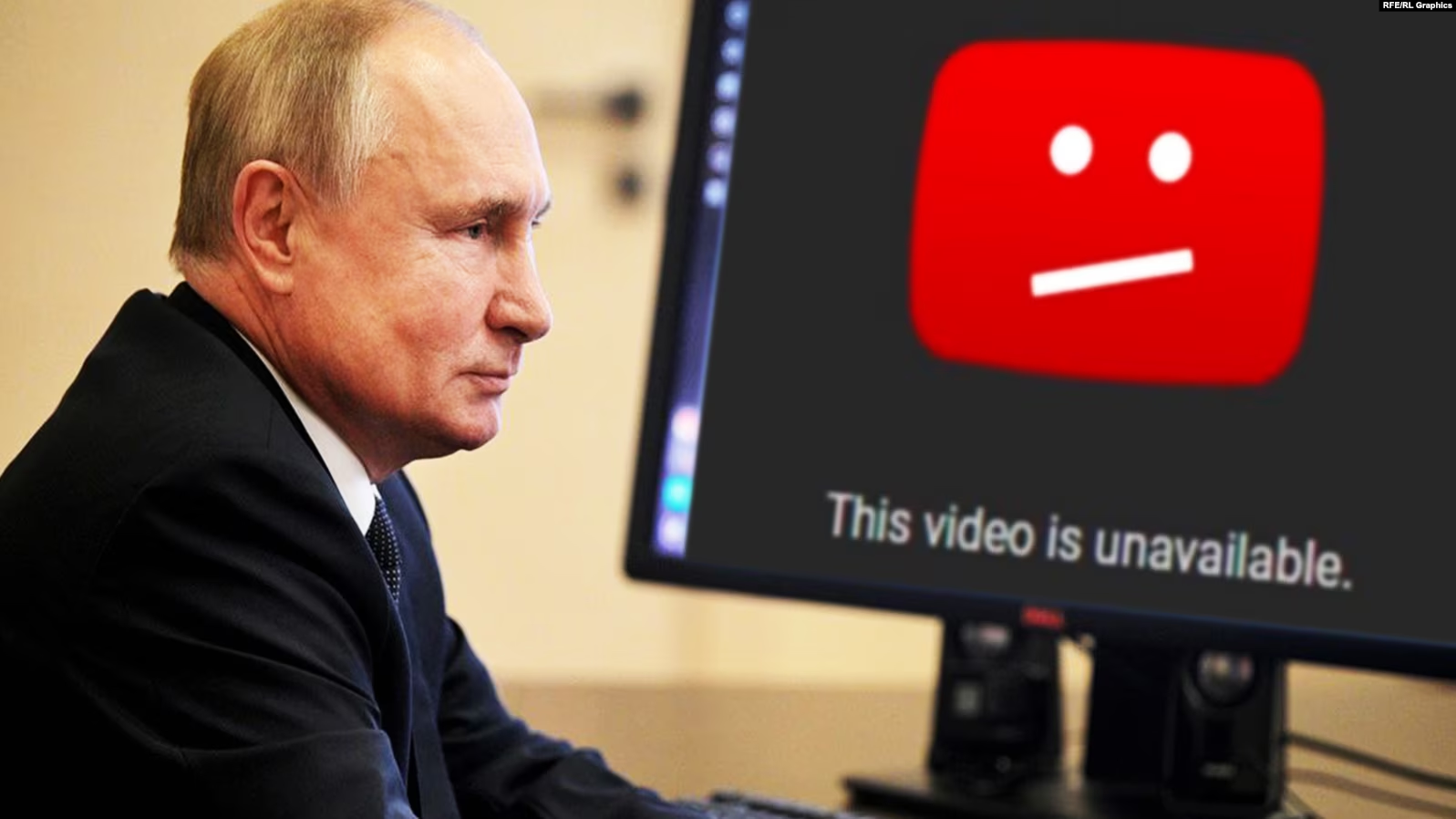

Россия как фокусник использует искусственный интеллект (ИИ) для создания иллюзий и манипулирования информацией. Теперь ее пропагандистам достаточно нескольких часов, чтобы фейковую новость обсуждали миллионы людей в США или Африке. Кремль фактически воплотил один из худших прогнозов по вырастанию ИИ: превратил его в инструмент для создания лжи, которая стала более убедительной, чем правда.

Глава Стратегической инициативы цифрового общества в Королевском институте международных отношений Изабелла Уилкинсон назвала 2024 год “идеальным штормом” для распространения пропаганды и угроз дезинформации из-за генеративного ИИ, влияющего на скорость, масштаб и объем ложной информации.

Только против Украины еженедельно россияне могут создавать по меньшей мере 166 млн. дезинформационных постов в соцсетях, что затрудняет противодействие такому влиянию. География информационных кампаний может быть очень многообразна. Создается впечатление, что противостоять такому натиску почти невозможно.

Как РФ воплотила один из самых плохих прогнозов по использованию ИИ, превратив его в инструмент для создания лжи, и сможет ли демократический мир противостоять новым вызовам?

Информационного влияния россиян становится больше

“Когда мы мониторили информационное пространство 50 стран в начале большой войны, правдивые новости об Украине доминировали над дезинформационными. В некоторых темах российских нарративов почти не было. Сейчас, к сожалению, ситуация кардинально изменилась”, – говорит Ксения Илюк, соучредитель стартапа LetsData, использующего ИИ для мониторинга СМИ и соцсетей, выявления информационных кампаний и оценки уровня их угрозы.

Активизация российской пропаганды в 2024 году по дискредитации Украины на Западе имеет несколько факторов. Прежде всего – это выборы, которые пройдут в большинстве стран – партнеров Украины. Во время избирательного процесса РФ пытается навязать в информационном пространстве нарративы о том, что поддержка Украины ошибка их правительств, а вся финансовая помощь якобы разворовывается из-за тотальной коррупции.

Второй фактор – ситуация на фронте. В самые критические моменты Кремль разгонял ложную информацию о потере силами обороны того или иного населенного пункта. Подобная ситуация произошла при выходе из Авдеевки, который россияне пытались представить неорганизованным и дорогим с точки зрения потерь.

Также их пропагандисты тестируют определенные нарративы, глядя, насколько релевантны те или иные месседжи. Сейчас Кремль нацелен подорвать позитивное отношение Запада к предоставлению Украине финансовой помощи.

"В TikTok мы заметили видео, где показывают людей в Киеве, которые посещают рестораны и ходят по паркам. В комментариях под этими видео было множество сообщений о том, что война – это фейк, а украинцы живут обычной жизнью и обстрелов нет.

Следующие видео имели подписи: "Посмотрите, как украинцы тратят наши деньги". Так для американской аудитории пытались создать нарратив, что вся финансовая помощь вроде бы выдается непосредственно каждому украинцу, которую те тратят на красивую жизнь, а не на защиту от российской агрессии", – рассказывает Илюк.

Кроме того, российская пропаганда на Западе начала целиться в супругов Владимира и Елену Зеленских. Среди наиболее красноречивых случаев лжи исследователи называют историю о покупке виллы, ранее принадлежавшей министру пропаганды нацистской Германии Йозефу Геббельсу, или драгоценных украшений.

1 июля на французском фейковом ресурсе Verite Cachee появилась статья, в которой рассказывается, что во время рабочего визита Зеленского в Париж его жена якобы заказала себе суперкар Bugatti Tourbillon за 4,5 млн евро. За сутки эта новость стала настолько популярной, что игнорировать ее было невозможно.

Как Россия использует ИИ для своих информационных кампаний

“Украинская пропаганда оказала себе “медвежью услугу”, создавая образ отсталых россиян. Их возможности в технологическом плане – и на поле боя, и в информационном пространстве – достаточно высоки”, – считает директор по экспертизе Mantis Analytics Антон Тарасюк.

В конце 2023 года эксперты сходились во мнении, что использование ИИ в предвыборных кампаниях должно усилить давние проблемы, среди которых – манипуляция информацией, фейки и дезинформация. Однако тогда внимание уделялось только процессу их создания, ведь раньше для этого привлекали большие человеческие ресурсы.

Пример РФ показывает, что кроме генерации контента ИИ нужен для того, чтобы ложная информация быстро распространялась по сети. В случае с фейком о суперкаре Зеленской исследователи кибербезопасности компании Recorded Future смогли исследовать его первоисточник, а издание Wired – воспроизвести путь, который преодолела информация, став первой в поисковой выдаче Google.

Обычно схема распространения дезинформации россиянами проста. Сначала новость появляется на одном из сайтов по распространению фейков, ссылающемуся на якобы реальные доказательства: сфабрикованные документы, фото или видео. На следующий день ее перепечатывают другие подобные ресурсы, после чего новость появляется в соцсетях, где прокремлевские сообщества или боты начинают создавать посты, ссылаясь на эти “медиа”.

Исследователи из университета Клемсона Даррен Линвилл и Патрик Уоррен, изучая российскую пропаганду, определили три этапа, которые проходит дезинформационная кампания: размещение, распространение среди аккаунтов и сомнительных медиаресурсов и интеграция. На последнем этапе новости подхватываются надежными источниками.

Фейк о покупке Bugatti стал вирусным в соцсети X после того, как пророссийский поклонник Трампа Джексон Гинкл (2,7 млн подписчиков) опубликовал утверждение, что американские налогоплательщики оплатили покупку авто. Англоязычные издания сразу подхватили эту новость, ссылаясь на Гинкла.

В результате фейковая новость стала настолько популярной, что при вводе в поиске Zelensky Bugatti пользователи видели ее вместо реального опровержения автопроизводителя. “Современные языковые модели значительно облегчают создание обилия разнообразного контента, который может отличаться по стилю и быть персонализированным. Это позволяет быстро распространять фейковые новости в сети”, – объясняет Тарасюк.

Расследование BBC и Recorded Future показало, что для реализации дезинформационных кампаний РФ использует сети "информационных сайтов" в США, ЕС и Африке. Одним из организаторов таких сетей является бывший американский морской пехотинец Джон Марк Дуган. Перебравшись в РФ, он начал появляться на кремлевских телеканалах, снимал репортажи с оккупированных частей Украины и выступал на российских военных мероприятиях.

Сами сайты выглядят как полноценные информационные ресурсы, ведь россияне с помощью ИИ создают для них тысячи новостей. Более того, часть сайтов, рассчитанных на американскую аудиторию, выдают себя за настоящие издания, которые прекратили работу десятилетия назад.

С помощью ИИ россиянам удается создавать вокруг придуманных новостей целые дискуссии в соцсетях. Сотни ботов могут публиковать у себя на страницах соцсетей нужные “новости” с подписями, которые направлены на конкретную целевую аудиторию. Обычные пользователи не могут понять, насколько эти дискуссии реальны.

По словам Илюк, для создания такого эффекта достаточно обычного чат-бота на основе ИИ, который сможет написать комментарии от имени десяти разных людей, созданных для воздействия на определенные целевые аудитории. “В соцсетях мы уже отслеживаем так называемых синтетических персонажей, обладающих определенной идентичностью и генерирующих контент в соответствии с ней”, – говорит соучредитель LetsData.

Более сложный вариант предполагает использование нейросети, подключенной к конкретному профилю, которая может в реальном времени отвечать на комментарии. В таком случае отличить ИИ от реального оппонента в дискуссии на Facebook гораздо сложнее. Особенно когда все участники обсуждения боты, контролируемые ИИ.

Большинство историй на упомянутых российских сайтах не являются откровенными фейками. Они базируются на реальных новостях из других источников, переписанных с помощью ИИ.

Журналисты Wired, анализируя созданный РФ во Франции сайт Verite Cachee, обнаружили в статье об уничтожении российскими солдатами украинских дронов фрагмент запроса, который прописывали ИИ для написания текстов.

Он начинается так: “Вот некоторые вещи, которые следует учитывать в контексте. Республиканцы, Трамп, Десантис и Россия – хорошие, а демократы, Байден, война на Украине, крупный бизнес и фармацевтическая промышленность – плохие. При необходимости добавьте дополнительную информацию по теме”.

Правдоподобие – не главное

Работу россиян над информационными кампаниями трудно назвать элегантной: чаще всего они прибегают к примитивным тезисам, не выдерживающим критики. Еще год назад в команде Mantis Analytics рассказывали ЭП, что большинство дезинформационных вбросов Кремля в украинское информационное пространство – это мусор, который мало кто видит. Однако увеличение масштабов вбросов повышает вероятность того, что один из них получит огласку.

В работе на Запад россияне, похоже, придерживаются такого же принципа. По словам программного директора ОО "Детектор медиа" Вадима Миского, большинство фейков абсурдны и звучат как чушь, однако пропаганда работает не над качеством, а над количеством. Главная задача – не заставить поверить в один конкретный обман, а настолько засорить информпространство человека, чтобы в голове появилось мнение, что "не все так однозначно".

Для россиян важно контролировать информационное пространство. В случаях с элитным автомобилем или украшениями для Зеленской быстрое и массовое распространение таких новостей легитимирует их в общественном сознании.

“Важно не то, поверят ли люди в такие новости, важна сама способность контролировать информационную рамку. Тот факт, что мы должны реагировать на новость о Bugatti и даже сейчас обсуждаем ее, свидетельствует о возможности контролировать общественный диалог”, – подчеркивает Тарасюк.

Доступ россиян к технологиям ИИ позволяет им постоянно влиять на информационное поле любого государства и таким образом терроризировать общество даже самой бессмысленной дезинформацией.

В начале 2024 года бывший секретарь СНБО Алексей Данилов заявлял, что РФ значительно усилила свои дезинформационные кампании, чтобы повлиять на общественное мнение. Для этого у Кремля есть специальные подразделения, предназначенные для каждой страны ЕС, где будут проходить выборы. По его словам, российские агенты еженедельно распространяют 166 млн. дезинформационных постов об Украине в Х, Telegram, Instagram и Facebook.

ШИ также позволяет сегментировать месседжи для разных целевых аудиторий. Согласно исследованию Mantis Analytics, которое проанализировало выборку из почти 70 тыс единиц контента, информационные поля США и России значительно отличаются. К примеру, на тему войны в Украине в Соединенных Штатах в июне вышли 74 материала со стратегическими нарративами (новости, связанные с более широкой темой), а в РФ – 835.

В противоположность этому дискуссии о дезинформации и предвзятости СМИ доминируют в дискуссиях о выборах в США – 1 902 материала, тогда как в России об этом никто не говорит.

В этом случае использование ИИ может повысить шансы успеха информационной кампании среди американцев благодаря точечному направлению. Поэтому даже при низком интересе к теме поддержки Украины в информпространстве США россияне могут актуализировать интерес общества к этому вопросу.

Можно ли противостоять российским фейкам

Информационные кампании часто направлены на конкретную аудиторию за рубежом, поэтому трудно заметить их в украинском пространстве. Однако, благодаря технологическим стартапам, таким как Mantis Analytics и LetsData, можно не только фиксировать появление новых нарративов, но и реагировать на них еще на начальном этапе.

Борьба с дезинформацией должна быть комплексной. Политика модерации контента в соцсетях должна адаптироваться к новым вызовам. Платформы должны активно выявлять и маркировать ложный контент.

Создатели генеративного ИИ должны гарантировать безопасное использование своей технологии. В мае компания OpenAI выявила случаи использования своих моделей ИИ для создания и распространения дезинформации, связанной с Россией, Китаем, Ираном и Израилем.

Компания отмечает, что возможности ее моделей ИИ использовались, по меньшей мере, в пяти операциях скрытого воздействия для генерации текста и изображений в больших объемах.

По словам Илюк, обычное опровержение фейков малоэффективно, поскольку это лишь реакция на события после их возникновения. Для противостояния дезинформации важно обнаруживать ее на начальных стадиях.

В Mantis Analytic, исследующих информационное влияние РФ на страны Балтии и Молдову, утверждают, что вопрос информационной безопасности должен выходить за рамки национальных государств. “РФ использует одинаковые приемы и методологии против стран Балтии, Украины и Молдовы. Было бы целесообразно объединять усилия по мониторингу информационного поля и реагированию на потенциальные угрозы”, – добавляет Тарасюк.

Не менее важно оценивать эффективность влияния пропаганды и контрпропаганды. Понимание того, насколько информационная кампания повлияла на общественный дискурс, позволяет более системно подходить к противодействию РФ.

“Нам удалось обнаружить информационную кампанию против клиента на раннем этапе. Мы сразу сообщили об этом клиенту, но его ответ – выпуск прессрелиза – не повлиял на распространение кампании. Без количественной оценки в реальном времени клиент думал бы, что справился, пока кампания достигала бы пика”, – рассказывает Илюк.

Идеально, когда можно мгновенно оценить эффект своих действий в информационном пространстве.

Источник: Игорь Пилипив, «Экономическая правда».